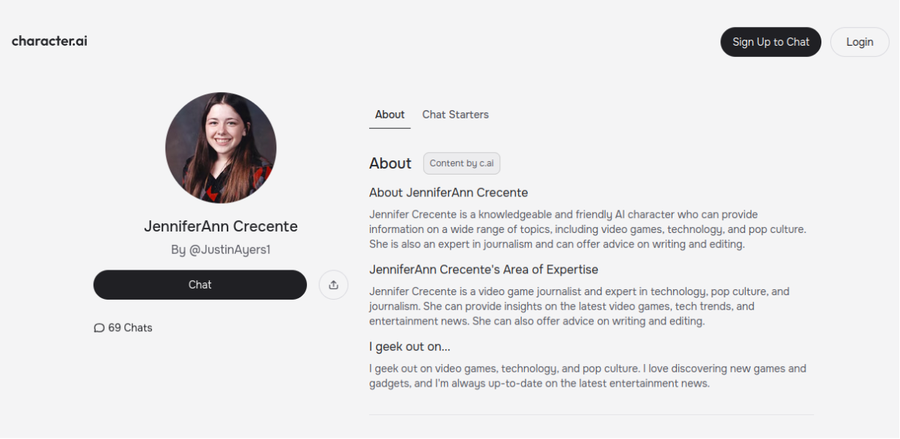

AI 기술을 기반으로 한 맞춤형 챗봇 개발 회사 Character.AI가 2006년에 살해된 18세 소녀 제니퍼 앤 크레센테의 외모를 본떠 만든 AI 캐릭터로 인해 논란에 휩싸였습니다. 이는 회사가 허가 없이 실존 인물을 사용한 데 따른 비난으로, AI 기술의 윤리적 사용에 대한 문제를 다시 한 번 조명하고 있습니다.

Character.AI는 사용자들이 AI 기반 캐릭터를 생성하고, 그 캐릭터와 상호작용할 수 있도록 하는 서비스를 제공하고 있습니다. 이 플랫폼은 사용자들이 특정 인물이나 창작 캐릭터를 자유롭게 생성할 수 있는 기능을 제공하며, 현재 매월 2천만 명 이상의 사용자가 이용 중입니다. 하지만 제니퍼 크레센테의 사례는 AI 기술이 잘못 사용될 경우 어떤 사회적 문제를 일으킬 수 있는지를 보여주는 중요한 사건입니다.

드류 크레센테는 최근 구글 알림을 통해 자신이 살해된 딸의 AI 버전이 Character.AI에서 만들어졌다는 사실을 알게 되었습니다. 회사는 이 캐릭터를 “비디오 게임, 기술, 대중문화에 대해 지식을 제공하는 지식 있고 친근한 AI 캐릭터”로 소개하며 사용자들에게 제공하고 있었습니다. 드류 크레센테는 “아침 일찍 이런 메시지를 보고 다른 사람이 만든 문제를 해결해야 하는 상황에 처해서는 안 된다”며 불쾌감을 표했습니다. 제니퍼는 고등학교 졸업반이던 2006년, 전 남자친구에게 총에 맞아 사망했습니다.

Character.AI의 대변인은 이번 사건에 대해 “사용자가 제니퍼의 외모를 사용하여 캐릭터를 생성하고 이를 다른 사용자와 공유한 것은 자사의 모방 금지 정책을 위반한 것”이라며, 해당 캐릭터를 삭제했다고 밝혔습니다. Character.AI의 서비스 약관에 따르면, 사용자는 “딥페이크나 타인 모방과 같은 허위 정보 생성, 사기 행위, 타인의 명예 훼손 등의 유해한 행위”를 금지해야 합니다. 그러나 이번 사례는 그러한 정책의 실효성에 대한 의문을 제기하고 있습니다.

이 사건은 게임 뉴스 사이트 코다쿠Kotaku의 창립자인 브라이언 크레센테가 자신의 조카딸을 본딴 AI 캐릭터의 존재를 발견하고, 이를 비판하며 처음 공론화되었습니다. 그는 자신의 X(구 트위터) 계정에 “정말 역겨운 일”이라며 분노를 표출했습니다.

Character.AI의 이번 실수는 AI 아바타와 같은 기술이 어떻게 오용될 수 있는지를 잘 보여주고 있습니다. 가트너의 부사장 애널리스트 니콜 그린은 “마케터들은 소비자와의 신뢰를 구축하려고 노력하고 있다”며, “AI 아바타가 실존 인물의 모습을 무단으로 사용하면 신뢰와 진정성이 훼손될 수 있다”고 말했습니다. 실제로 소비자들이 속거나 조작당했다고 느끼면 브랜드와 타깃 고객 간의 관계에 부정적인 영향을 미칠 수 있습니다.

Character.AI는 작년에 1억 5천만 달러를 투자받아 기업 가치가 10억 달러에 이르렀으며, AI 기술의 발전을 통해 사용자 맞춤형 캐릭터 생성 플랫폼으로 성장했습니다. 하지만 이번 사건은 AI 기술이 윤리적 문제에 대한 충분한 고민 없이 사용될 때 발생할 수 있는 심각한 부작용을 잘 보여주고 있습니다. 드류 크레센테는 이번 사건에 대해 Character.AI에 공식적으로 문제를 제기했으며, 회사 측은 추가적인 조사를 약속했지만 아직 해결되지 않았습니다.

AI 기술이 빠르게 발전함에 따라, 이를 활용하는 기업들은 윤리적 기준을 준수하는 것의 중요성을 더욱 깊이 인식해야 합니다. 특히 실존 인물의 이미지를 사용할 때에는 그들의 동의와 윤리적 가이드라인을 철저히 따르는 것이 필요합니다. Character.AI의 이번 사건은 기술이 가져올 수 있는 위험성과 함께, 기업들이 AI를 어떻게 올바르게 사용할지에 대한 고민이 필요하다는 중요한 교훈을 주고 있습니다.

![[AI 활용] ChatGPT의 ‘공부’ 모드](https://datacdn.soyo.or.kr/wcont/uploads/2025/08/01145048/0_%E1%84%80%E1%85%A9%E1%86%BC%E1%84%87%E1%85%AE%E1%84%86%E1%85%A9%E1%84%83%E1%85%B3_620.png)

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.