OpenAI는 보고서에서 매일 4천만 명이 ChatGPT로 건강 관련 질문을 하고, ChatGPT에서 오가는 질문 중 5% 이상이 건강 관련이라고 밝혔습니다. 또한 주간 사용자 8억 명 가운데 2억 명이 적어도 일주일에 한 번 이상 건강 관련 질문을 던진다고 설명합니다. 숫자만 보면 기술의 승리처럼 보이지만, 그 이면은 오히려 오늘의 의료 시스템이 쌓아 올린 불편과 결핍의 합계에 가깝습니다.

사람들이 의료 정보나 상담을 AI에 의존하는 이유는 대개 “AI가 더 똑똑해졌기 때문”이 아니라, “의료가 덜 닿기 때문”입니다. 예약은 어렵고, 대기 시간은 길고, 아픈 시간은 진료 시간표를 배려하지 않습니다. 진료실 밖에서 환자는 다시 혼자가 됩니다. 그때 가장 손쉬운 대안은, 언제든 말을 걸 수 있는 창구입니다. 의료의 접근성이 얇아진 자리로 AI가 들어온 것입니다.

비용 문제는 더 직접적입니다. 의료는 치료의 비용만이 아니라 ‘불확실성의 비용’을 함께 요구합니다. 어디로 가야 하는지, 얼마나 나올지, 무엇이 필요한지, 어떤 질문을 해야 하는지 알기 어렵고, 그 어려움 자체가 불안을 키웁니다. 환자가 AI에게 묻는 것은 종종 증상 그 자체가 아니라, 의료 시스템이 만든 불투명함을 번역해 달라는 요청입니다.

의사와 환자의 소통 문제는 이 흐름을 더욱 가속합니다. 진료는 늘 압축되어 있고, 설명은 빠르며, 환자는 긴장 속에서 질문을 놓칩니다. 집에 돌아와서야 “그 말이 무슨 뜻이었지?”가 시작됩니다. OpenAI가 지난 3개월 동안 의료 분야에 AI를 사용한 미국 성인 1,042명을 대상으로 한 조사에서, 응답자들은 챗봇을 증상 확인 또는 탐색(55%), 언제든지 의료 관련 질문(52%), 의학 용어 또는 지시 사항 이해(48%), 치료 옵션 정보 습득(44%)에 사용했다고 답했습니다. 환자들이 원하는 것은 의사가 사라지는 의료가 아니라, 이해 가능한 의료입니다.

물론 위험은 분명합니다. 챗봇은 환자의 전체 병력과 진찰 소견, 검사 결과의 맥락을 알지 못합니다. 그럼에도 문장은 단정적으로 들릴 수 있고, 사용자가 그 단정을 권위로 오해하는 순간 지연 진료나 위험한 자기 확신이 생깁니다. 그래서 AI는 진단을 대신하는 존재가 아니라, 정보를 구조화하고 질문을 준비시키는 보조 도구로 자리 잡아야 합니다. 그러나 이 원칙은 개인의 절제만으로 지켜지기 어렵습니다. 사람들을 AI로 밀어 넣는 힘이 기술의 유혹이 아니라 의료 시스템의 마찰이라면, 그 마찰이 줄지 않는 한 AI는 ‘보조’에서 ‘대체’로 미끄러질 수밖에 없습니다.

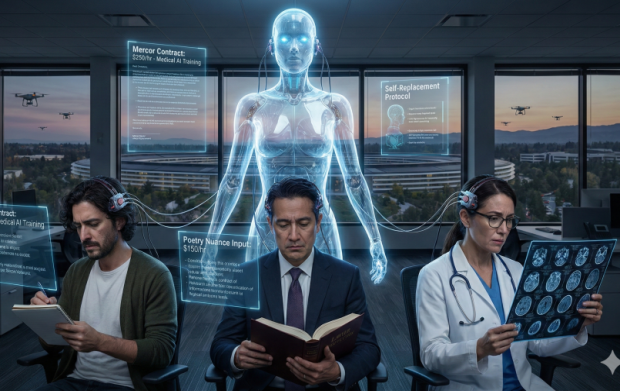

이 지점에서 전통적인 환자–의사 관계의 변화는 불가피합니다. 환자는 진료 전에 AI와 먼저 대화하며 증상을 정리하고 질문을 준비할 것입니다. 의사는 그 요약을 검토하고 오류를 바로잡으며, 위험 신호를 골라내고, 환자가 놓치기 쉬운 맥락을 채워 넣는 역할을 더 크게 떠맡게 될 가능성이 큽니다. 진료의 권위가 사라지는 것이 아니라, 권위가 작동하는 방식이 재편되는 것입니다. 의료의 ‘입구’가 이미 바뀌고 있는데, 출구만 과거의 형태로 고정할 수는 없습니다.

그런데 한국은 이 변화 앞에서, 이상하리만큼 자주 고개를 돌립니다. 의료의 공백을 어떻게 메울지, 환자 안전을 어떻게 지킬지, 소통과 비용과 접근성을 어떻게 개선할지의 논의는 뒤로 밀리고, 대신 ‘기존 질서’를 둘러싼 진영 논리와 이해관계가 전면에 섭니다. 학부모의 불안은 더 나은 의료로 이어지기보다 ‘의대 합격’으로 환치되고, 의료계의 에너지는 새로운 협업과 책임의 설계보다 권한의 방어에 집중되기 쉽습니다. 시스템 문제를 입시와 지위 경쟁으로 해결하려는 것은 애초에 잘못된 답인데도, 우리는 그 잘못된 답을 너무 오래 반복해 왔습니다.

AI가 의료의 빈틈을 메우기 시작한 지금, 중요한 질문은 “AI를 쓸 것인가 말 것인가”가 아닙니다. “의료 시스템이 스스로 바뀔 것인가, 아니면 변화의 파도를 외면한 채 기득권을 지키는 논리로 버틸 것인가”입니다. 한국의 의사들은 10년 뒤에도 지금과 같은 주장을 할 수 있을까요?

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.