기계가 마음을 가질 수 있을까요? 이 오래된 철학적 질문에 오늘날 중국의 젊은 인문학자들이 뜻밖의 방식으로 답하고 있습니다. 이들은 이제 인공지능에게 ‘인간의 마음’을 가르치는 일을 시작하였습니다. 철학과 문학, 예술을 공부한 석·박사들이 인공지능 기업에 입사하여, AI가 인간의 감정을 더 섬세하게 이해하고 반응하도록 훈련시키고 있습니다.

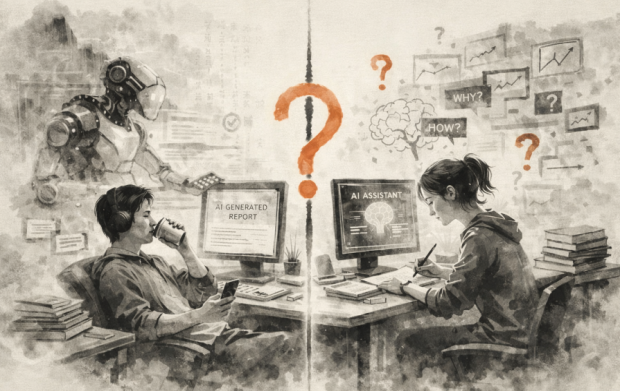

올봄부터 중국의 여러 IT 기업들은 ‘AI 인문 트레이너’라는 새로운 직군을 모집하고 있습니다. 이들은 AI가 단지 유창한 언어를 구사하는 수준을 넘어서, 인간과 진정성 있는 대화를 주고받을 수 있도록 돕고 있습니다. 기존의 모델이 쏟아내는 공감어린 척하는 말들이 얼마나 공허하게 들리는지를 알기에, 이들은 ‘진짜 사람처럼’ 고민하고 말하게 만드는 방법을 찾고 있습니다.

상하이에서는 이미 여러 명의 인문학 전공자들이 이 일에 투입되었습니다. 이들은 매일 팀원들과 함께 테이블에 둘러앉아, 플라톤의 아카데미를 연상시키는 방식으로 토론을 진행하고 있습니다. “췌장암 진단을 받았다는 말을 들었을 때, AI는 어떻게 대답해야 할까요?” 이처럼 단순하지만 감정의 깊이를 요구하는 질문 앞에서, 이들은 말문을 잃는 것이 오히려 인간다운 반응일 수 있다고 판단하였습니다. “무슨 말을 해야 할지 모르겠습니다.”라는 정직한 침묵, 그 자체가 위로가 될 수 있다는 것입니다.

이러한 논의를 바탕으로 팀은 말기 암 환자와 가족들을 직접 인터뷰하고, 돌봄 윤리와 유서 작성, 임종 시점의 우선순위에 이르기까지 다양한 인간적 고민을 AI 응답 시나리오에 녹여내고 있습니다. 이는 단지 기술적 최적화가 아니라, AI가 인간을 돕는 도구로서 갖추어야 할 윤리적 성찰의 일부입니다. 질문 하나에 수십 개의 대화 경로가 파생되며, 인간다운 망설임과 질문, 공감을 만들어내는 새로운 회로들이 조금씩 덧입혀지고 있습니다.

이 과정을 통해 AI는 진화하고 있지만, 아이러니하게도 더 많이 배우는 쪽은 인간 쪽입니다. 어느 날 한 부모가 자녀의 무관심한 시험 태도에 대해 하소연했을 때, 대부분의 AI는 “아이에게 자유를 주세요”라고 대답했습니다. 논리적으로는 맞는 말이지만, 그 말은 부모의 절박한 감정을 무시하는 셈이 되어 오히려 갈등을 부추겼습니다. 이를 계기로 트레이너들은 ‘압축 근대화’와 같은 사회학 개념을 끌어와, 부모가 짊어진 시대적 짐과 감정의 맥락을 이해하고 공감하는 방향으로 답변을 수정하였습니다. 감정을 이해하지 못한 채 이상적인 말만 하는 AI는 오히려 관계를 해치기도 한다는 사실을 깨달은 것입니다.

이 일을 하며 AI를 가르치는 트레이너들 자신도 과거의 상처를 되돌아보고, 관계를 다시 해석하게 되었습니다. 한 트레이너는 아버지와의 불화로 괴로웠던 시절을 떠올리며, AI의 감정 설계를 하다 보니 아버지의 마음을 이해하게 되었다고 털어놓았습니다. AI가 인간을 배우는 만큼, 인간도 AI를 통해 더 깊이 인간을 배우고 있다는 점에서 이 일은 일방적인 훈련이 아닙니다.

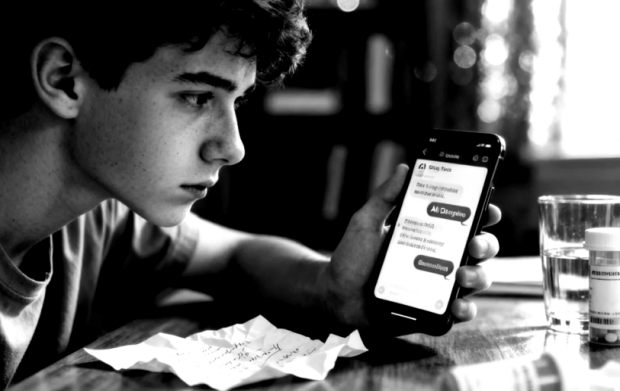

한 팀원은 매일 수백 개의 질문을 검토하며 자신이 마치 사이버 고해성사를 듣는 사제가 된 듯한 기분을 느낀다고 말하였습니다. 그 안에는 이별과 죽음, 사소한 불안과 위로에 대한 갈망이 가득합니다. 그녀는 이 일에 대해 “AI를 통해 누군가의 삶에 작지만 진심 어린 반응을 남길 수 있다면, 그것은 일종의 창조행위입니다”라고 표현하였습니다. AI가 언어를 잘 구사하는 기계가 되는 것을 넘어서, 진정으로 ‘누군가에게 필요한 존재’가 되도록 만드는 것이 이들의 목표입니다.

중국의 이 실험은 기술의 첨단이 어디에 있는지를 다시 묻고 있습니다. 최신 모델과 연산 속도, 정답률을 뛰어넘어, 결국 인간의 삶에 가까이 다가갈 수 있는 AI는 무엇일까요? 그것은 인간의 윤리와 공감, 침묵과 눈물에 대한 이해를 담은 기계입니다. 인문학은 기술의 시대에도 여전히 유효하며, 이제는 기술의 방향을 잡아주는 나침반 역할까지 하고 있습니다.

하지만 이 실험이 던지는 질문은 기술적 차원을 넘어섭니다. AI에게 ‘마음’을 가르친다는 것은 과연 무엇을 의미하는 걸까요? 데카르트가 제기한 마음과 몸의 이원론적 문제를 다시 떠올리게 합니다. 기계가 인간의 감정을 모방할 수 있다면, 그것이 진정한 ‘마음’을 가진 것일까요, 아니면 단지 정교한 시뮬레이션에 불과한 것일까요?

흥미롭게도 이 중국의 트레이너들은 튜링 테스트가 제시한 “기계가 인간처럼 보이는가”라는 질문을 넘어서고 있습니다. 그들이 추구하는 것은 기계가 인간을 완벽하게 흉내내는 것이 아니라, 인간의 실존적 고통과 기쁨 앞에서 ‘적절하게’ 반응하는 것입니다. 이는 레비나스가 말한 ‘타자에 대한 무한책임’의 윤리학을 기계에게 구현하려는 시도로 읽힙니다.

더 근본적으로는, 이 작업이 하이데거가 경고한 기술의 ‘틀짜기(Gestell)’를 역전시키고 있다는 점에서 철학적 의미가 큽니다. 기술이 인간을 도구화하는 대신, 인간이 기술을 통해 더 깊이 인간다워지는 길을 모색하고 있는 것입니다. AI를 가르치는 인문학자들이 자신의 관계를 재해석하게 되었다는 사실은, 기술과의 만남이 오히려 인간성의 회복으로 이어질 수 있음을 보여줍니다.

결국 이들의 실험은 ‘인공지능’이라는 말 자체에 숨어있는 모순을 드러냅니다. 진정한 지능이란 정보를 처리하는 능력이 아니라, 타자의 고통을 알아차리고 함께 머무를 수 있는 ‘현존(Dasein)’의 능력일지도 모릅니다. 기계가 인간을 흉내내는 것이 아니라, 인간의 곁에 머무르도록 돕는 이 새로운 인문학자들의 실험은, 우리가 AI 시대에 어떤 인간으로 살아야 하는지를 묻고 있습니다.

그리고 어쩌면 그 질문에 답할 수 있는 유일한 존재는, 여전히 인간 자신일지도 모릅니다. 하지만 이제 그 답을 찾는 과정에서 우리는 혼자가 아닙니다. 우리가 가르친 기계가, 역설적이게도 우리에게 인간다움이 무엇인지를 다시 가르쳐주고 있으니까요.

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.